Chain-of-thought Prompting Elicits Reasoning In Large Language Models

Hey Leute, habt ihr euch jemals gefragt, was wirklich *hinter* den Kulissen von diesen krassen KI-Modellen abgeht? Ich meine, wie schaffen die es, so schlau zu wirken? Tja, es gibt da ein cooles Konzept, das ich euch heute vorstellen möchte: Chain-of-Thought Prompting. Klingt kompliziert? Keine Sorge, wir machen's locker!

Was zum Teufel ist Chain-of-Thought?

Stellt euch vor, ihr fragt ein Kind: "Lisa hat 3 Äpfel. Max gibt ihr noch 2. Wie viele Äpfel hat Lisa jetzt?" Die meisten Kinder werden nicht einfach "5" raushauen (obwohl das die richtige Antwort ist!), sondern eher sagen: "Lisa hatte 3, dann kommen noch 2 dazu, also rechne ich 3 plus 2, und das ist 5!" Das ist im Grunde genommen Chain-of-Thought: Der Denkprozess wird *explizit* dargestellt.

Bei Large Language Models (LLMs), also diesen riesigen Textgeneratoren, ist das ähnlich. Anstatt ihnen einfach eine Frage vorzuwerfen und auf die Antwort zu hoffen, geben wir ihnen quasi Denkanstöße. Wir zwingen sie, ihren Denkprozess zu "zeigen".

Nehmen wir mal an, wir wollen, dass ein LLM ein komplexes Rechenproblem löst. Anstatt einfach zu fragen: "Was ist die Wurzel aus 144 plus 7 mal 3?", geben wir ihm ein Beispiel, wie *wir* es lösen würden, Schritt für Schritt. So nach dem Motto: "Um das zu lösen, würde ich zuerst 7 mal 3 rechnen, das ergibt 21. Dann würde ich 144 plus 21 rechnen, das ergibt 165. Und dann würde ich die Wurzel aus 165 ziehen..." Ihr versteht das Prinzip?

Warum ist das so cool?

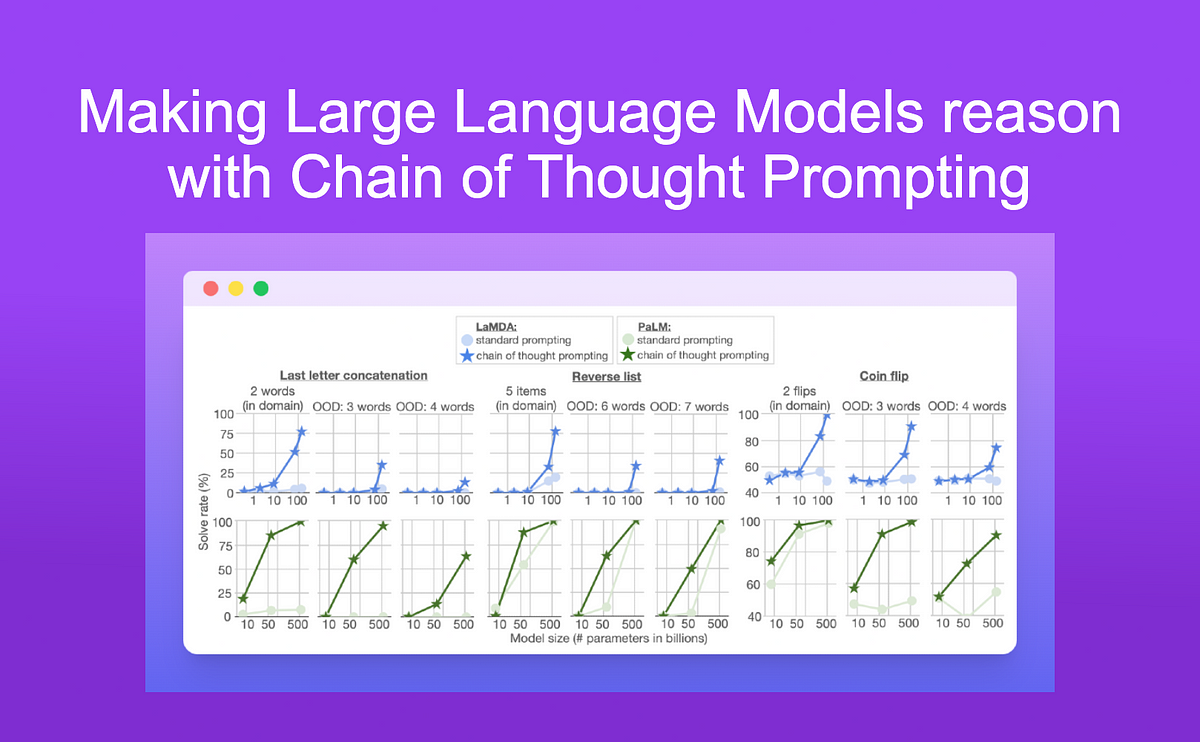

Ganz einfach: Weil es funktioniert! Chain-of-Thought Prompting hilft LLMs, *genauer* zu sein. Stell dir vor, du würdest einem Freund nur das Endergebnis einer komplizierten Rechnung zeigen, ohne ihm zu erklären, wie du dahin gekommen bist. Er würde dir wahrscheinlich nicht glauben, oder? Mit Chain-of-Thought können wir *nachvollziehen*, wie das LLM zu seiner Antwort gekommen ist. Das schafft Vertrauen!

Es ist, als würde man einem Zauberer nicht nur den fertigen Trick zeigen, sondern ihm auch die Handgriffe erklären, die ihn zum Meister machen. Plötzlich wird der Zauber nachvollziehbarer – und beeindruckender!

Und das Beste daran: Es verbessert die Leistung *ohne* die Notwendigkeit, das Modell neu zu trainieren. Wir müssen also nicht Millionen von Euro investieren, um das Modell intelligenter zu machen. Wir müssen ihm nur *bessere* Fragen stellen!

Wie funktioniert das in der Praxis?

Es gibt verschiedene Möglichkeiten, Chain-of-Thought Prompting anzuwenden. Eine beliebte Methode ist das "Few-Shot Prompting". Dabei geben wir dem LLM ein paar Beispiele für Frage-Antwort-Paare, *inklusive* der Denkprozesse dazwischen. Also z.B.:

Frage: Lisa hat 5 Murmeln. Tom nimmt ihr 2 weg. Wie viele Murmeln hat Lisa jetzt?

Antwort: Lisa hatte 5 Murmeln, Tom nimmt ihr 2 weg, also rechne ich 5 minus 2, das ergibt 3. Lisa hat jetzt 3 Murmeln.

Und dann geben wir dem LLM unsere eigentliche Frage, von der wir wollen, dass es sie beantwortet. Das LLM lernt quasi von den Beispielen und ahmt den Denkprozess nach.

Das ist so, als würde man einem Kochlehrling zeigen, wie man ein bestimmtes Gericht zubereitet, inklusive aller Tricks und Kniffe. Der Lehrling kann dann diese Techniken anwenden, um ähnliche Gerichte zu kochen. Genial, oder?

Wo geht die Reise hin?

Chain-of-Thought Prompting ist noch relativ neu, aber es hat schon jetzt gezeigt, was in LLMs steckt. Es ist, als hätten wir einen verborgenen Schalter gefunden, der die Denkprozesse der Modelle aktiviert. Die Möglichkeiten sind *unendlich*.

Wir können damit komplexere Probleme lösen, bessere Entscheidungen treffen und sogar kreativere Inhalte generieren. Und wer weiß, vielleicht führt uns Chain-of-Thought Prompting eines Tages sogar zu einer *wirklich* intelligenten KI. Eine KI, die nicht nur clever ist, sondern auch nachvollziehbar und transparent.

Also, bleibt neugierig und experimentiert mit Chain-of-Thought Prompting! Es ist ein spannendes Feld, das uns noch viele Überraschungen bescheren wird.

Denkt daran: Die Zukunft ist jetzt – und sie wird von intelligenten Algorithmen und klugen Köpfen gestaltet. Lasst uns gemeinsam die Welt der KI erkunden!